![深度学习——理论、方法与PyTorch实践 《深度学习——理论、方法与PyTorch实践》[93M]百度网盘|pdf下载|亲测有效](/downpdf2/uploads/s0309/9a12f0245b3200cb.jpg)

![《深度学习——理论、方法与PyTorch实践》[93M]百度网盘|pdf下载|亲测有效](/downpdf2/uploads/s0309/9a12f0245b3200cb.jpg)

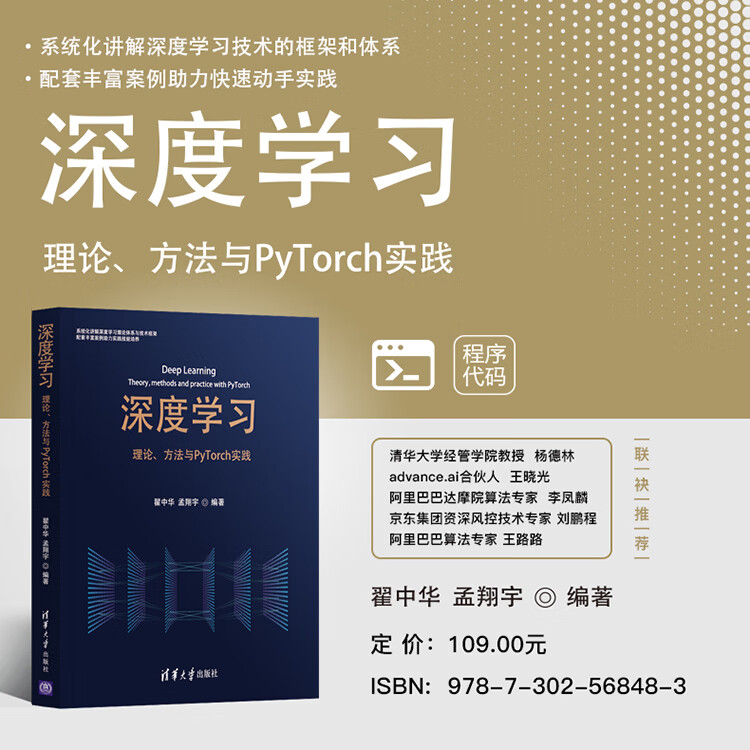

深度学习——理论、方法与PyTorch实践 pdf下载

内容简介

本篇主要提供深度学习——理论、方法与PyTorch实践电子书的pdf版本下载,本电子书下载方式为百度网盘方式,点击以上按钮下单完成后即会通过邮件和网页的方式发货,有问题请联系邮箱ebook666@outlook.com

产品特色

编辑推荐

学习思路,理论先行:构建了非常系统化的理论知识体系,助力读者透彻理解深度学习的基础知识。

学习原理,思维先行:学习一种新的方法、新的算法时,先从本质上剖析其来源,分析提出这种新方法的思维是什么。

抽丝剥茧、深挖本质:透过其烦杂的表面,深挖其本质。

纵向学习、横向比较:详细讲解深度学习作为语言模型中很有用的一种技巧,如何在很多方法中被借鉴和使用。

实践有章可循,拒绝举轻若重:本书将实践分为原理实践和应用实践。原理实践注重案例与原理的呼应,增强对于原理的理解和认识;代码实践增加不同场景下的实践技能,提高Python实践水平。

内容简介

本书深入浅出地讲解深度学习,对复杂的概念深挖其本质,让其简单化;对简单的概念深挖其联系,使其丰富化。从理论知识到实战项目,内容翔实。

本书分为两篇,基础篇主要讲解深度学习的理论知识,实战篇是代码实践及应用。基础篇(第1~13章)包括由传统机器学习到深度学习的过渡、图像分类的数据驱动方法、Softmax损失函数、优化方法与梯度、卷积神经网络的各种概念、卷积过程、卷积神经网络各种训练技巧、梯度反传、各种卷积网络架构、递归神经网络和序列模型、基于深度学习的语言模型、生成模型、生成对抗网络等内容;实战篇(第14~19章)包括应用卷积神经网络进行图像分类、各种网络架构、网络各层可视化、猫狗图像识别、文本分类、GAN图像生成等。

本书适合人工智能专业的本科生、研究生,想转型人工智能的IT从业者,以及想从零开始了解并掌握深度学习的读者阅读。

作者简介

翟中华 清华大学硕士毕业,北京洪策元创智能科技有限公司CEO,AI火箭营首席讲师。在机器学习、深度学习、计算机视觉、自然语言处理等人工智能领域有扎实的理论基础和丰富的应用实践经验。主讲的课程“深度学习入门系列讲解”“PyTorch深度学习实战”等累计学员约50万人次,讲课风格抽丝剥茧、尝入浅出、以简驭繁,能够把复杂的原理简单化,把简单的原理内涵化,深受广大学员的认可。

孟翔宇 华中科技大学软件工程硕士,现就职于阿里巴巴集团(杭州),先后从事面向B类外贸电商的商家生命周期建模、计算广告相关性匹配和推荐广告召回等领域的研究和实践工作。拥有工业海量数据场景下的建模理论和实战经验,对多种机器学习、深度学习和强化学习模型有着浓厚的兴趣和较深的理解。

精彩书评

★深度学习是人工智能从概念到繁荣得以实现的主流技术,以深度学习技术为核心的人工智能技术将极大地升级改造传统农业、工业、服务业。无论你从事哪个行业,《深度学习——理论、方法与PyTorch实践》一书都值得学习。本书既适合作为高等学校深度学习课程的教材和参考书,也适合深度学习领域的研究人员阅读。

——杨德林 清华大学经管学院教授/中国技术经济学会副理事长

★2012年深度学习技术的崛起,把人工智能提升到了前所未有的高度。《深度学习——理论、方法与PyTorch实践》系统、深入地为读者讲述现代深度学习技术的全局框架,书中不仅对深度学习的理论知识进行了充分讲解,而且通过具体的案例,让读者可以按照步骤完成自己的深度学习模型。本书的案例生动而且图文并茂,书中大量直观、有趣的插图会让读者身临其境地感受深度学习的魅力,相信阅读本书的过程将是一趟非常愉悦的深度学习之旅。

——王晓光 ADVANCE.AI合伙人

★自然界充斥着各种形式的智能,从微小的细菌到复杂的人类智能,每种智能都适应了它在自然界中的位置。人工智能也将以多种形式出现,并在智能族谱中占据特殊的位置。《深度学习——理论、方法与PyTorch实践》从应用的角度,以丰富的案例和图解的方式对深度学习系列模型进行了深入浅出的解析,内容翔实,易于理解,非常值得阅读。

——李凤麟 阿里巴巴达摩院算法专家

★随着互联网技术的迅猛发展,场景下的海量数据沉淀越来越多。与此同时,计算机算力的提升使得众多行业有能力、有机会通过场景+大数据+机器学习实现弯道超车。《深度学习——理论、方法与PyTorch实践》深入浅出,案例丰富。祝愿读者能够快乐地在知识海洋之中畅游!

——刘鹏程 京东集团资深风控技术专家

★深度学习技术作为近些年人工智能领域的伟大变革,进一步探索人类对自然世界的理解和表征。随着硬件和软件设备的不断更新,深度学习技术不仅在图像处理、自然语言处理、视频处理等领域得到了广泛的应用,而且应用到工业界的众多模块中,大大拓展了工业级产品的优化效率。本书图文并茂,帮助读者构建深度学习的知识体系,并通过生动翔实的案例引导读者探索深度学习技术在实际场景中发挥的作用。

——王路路 阿里巴巴ICBU技术部算法专家

![《文坛故旧录》[99M]百度网盘|pdf下载|亲测有效](/downpdf2/uploads/2024-01-20/8e9fd88f74b3fae4.jpg)

![《正版【满48包邮】数据中台:让数据用起来9787111642404机械工业》[51M]百度网盘|pdf下载|亲测有效](/downpdf2/uploads/53a23e7422966709.jpg)

![《题库速发诊断技术类教学资源库诊断技术类教学资源库z》[68M]百度网盘|pdf下载|亲测有效](/downpdf2/uploads/2024-01-20/59111d89N31585053.png)

![《SolidWrks高级零件和曲面建模》[55M]百度网盘|pdf下载|亲测有效](/downpdf2/uploads/2024-01-20/6e6f6c96c7372bb9.jpg)